个人电脑(PC)行业正因为一个新甜点而日益升温中:这就是具有人工智能(AI)功能的PC。包括英特尔(Intel)和微软(Microsoft)等这一波PC革命的主要受益者,目前正积极推动配备AI CPU和AI软件助理的PC,并逐渐将AI应用从云端移至PC领域。

换句话说,嵌入专用芯片的AI PC可以在本地执行AI模型,而无需依赖云端。英特尔CEO Pat Gelsinger认为,相较于使用以云为中心的数据中心服务,这将使AI服务变得更便宜、更快速,也更具有稳私性。他在年初于美国拉斯维加斯举行的CES 2024上说:“未来,你将为每个人、每个用例以及每个地点释放这种力量。”

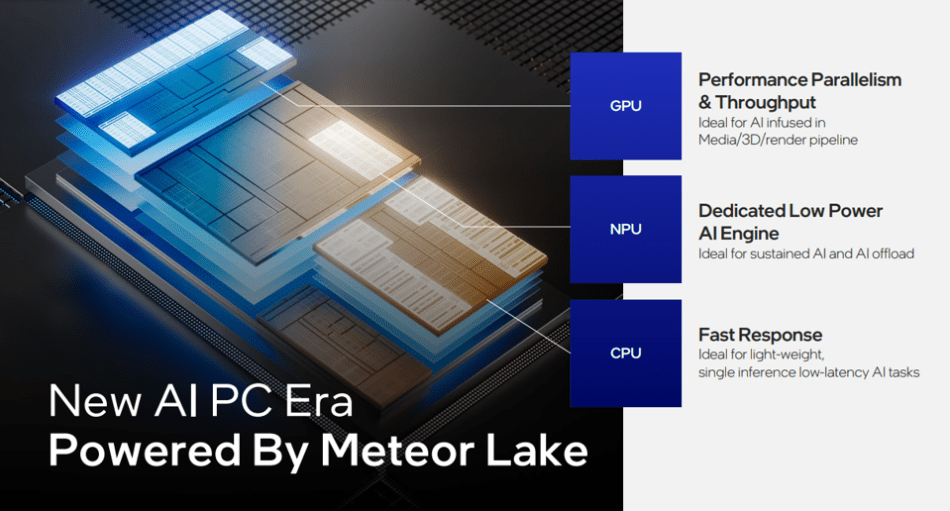

在服务器领域与AI巨头Nvidia展开竞争的同时,英特尔显然也看到了在自己的强项—“PC处理器”领域迎头赶上的机会。英特尔目前正积极地将其神经处理器单元(NPU)集成于PC处理器中,NPU正是专门用于处理AI任务的专用半导体。

英特尔的Meteor Lake笔记本电脑CPU中集成了一款NPU,以支持第三方厂商的AI软件功能。其于PC硬件领域的老对手AMD也在推出AI PC处理器。紧接着,Nvidia在其于CES 2024前的一次线上活动中则发表了三款新的产品,包括GPU–RTX 4060 Super、RTX 4070 Ti Super和RTX 4080 Super,用于支持AI功能的笔记本电脑。

图1:Meteor Lake CPU集成了一款NPU,以支持AI应用。(来源:Intel)

除了支持AI的处理器,美光(Micron)、三星(Samsung)和SK海力士(SK Hynix)等存储芯片制造商也在关注AI PC,期望让AI加速器得以在PC上执行强大的辅助功能。目前,新款笔记本电脑搭配容量高达8GB的RAM,而基于Windows的AI PC所支持的内存容量很可能增加一倍。事实上,执行AI助手的大语言模型(LLM)可能需要超过16GB的内存。

以Meta创建的Llama 2系列AI模型为例,其普通版本就需要将近30GB的RAM。此外,随着更强大的AI加速器和处理器的出现,AI PC的内存容量可能必须要再增加。

图2:Copilot AI助手是以OpenAI的GPT-4模型为基础而构建的。(来源:Microsoft)

目前,消费者对于AI PC的热情可以说才刚刚在“热身”阶段,要能够为AI PC提供更多原生应用还需要一段时间。然而,随着时间的进展,AI PC的硬件和软件都将变得更加强大,而这对于CPU、GPU和DRAM等半导体组件来说更是大好消息。

(原文刊登于EDN美国版,参考链接:Will AI PCs be a new sweet spot for CPUs and DRAMs?,由Susan Hong编译)

最前沿的电子设计资讯

最前沿的电子设计资讯