人工智能(AI)这个词有些用词不当。人工智能既不是人工,也不是智能的。言下之意,人工智能类似于人类智能,但人工智能需要大量的人类训练才能发挥作用,并且在识别、理解、分类物体或场景方面表现出与人类截然不同的逻辑。人工智能通常缺乏任何常识,很容易被愚弄或破坏,并且可能以意想不到和不可预测的方式失败。

换句话说,要谨慎行事。

本文将探讨人工智能技术如何影响汽车行业。我们会考虑:

人工智能开发分为三个阶段:构建人工智能模型、使用相关数据训练人工智能模型、使用训练好的模型解决问题(推理阶段)。

大多数人工智能模型都基于多个版本的神经网络和学习网络。示例包括卷积神经网络、生成对抗网络、深度强化学习、联邦学习和迁移学习。每个都有不同的优缺点。一切都在迅速发展。

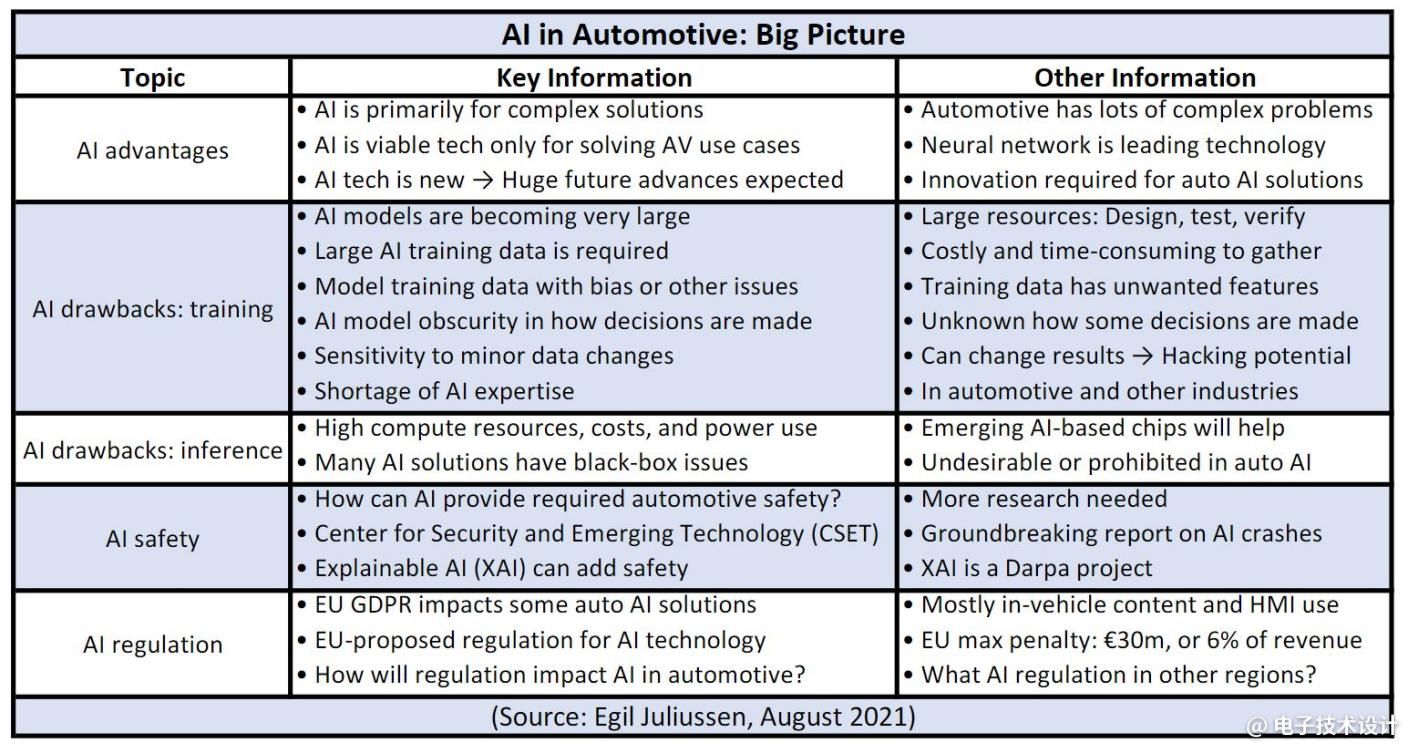

图1总结了人工智能技术的优缺点以及安全注意事项和拟议法规。

图1:人工智能在汽车领域的总体情况。

人工智能主要被用于解决复杂的问题。因为汽车行业存在许多难题,人工智能在推动汽车技术发展方面发挥越来越大的作用。部署自动驾驶汽车的前景,主要依赖于新的人工智能技术。基本的共识是,神经网络的进步是引领未来自动驾驶汽车部署成功的方法。

好消息是人工智能,尤其是神经网络技术,正处于研发阶段。这意味着其将取得进步,有望实现突破性创新。随着在全球范围内对人工智能持续大量投资,这是一个不错的选择,人工智能和神经网络将解决许多更复杂的问题,包括汽车行业的挑战。

开发和部署人工智能技术的挑战之一是对神经网络的充分训练。一般来说,问题越复杂,神经网络模型就必须越复杂。这意味着大型模型。训练需要大量资源和专业知识来设计和测试人工智能模型,这依赖于大型数据集来校验是否模型像宣传的那样。

更大的训练数据集将会出现,但训练仍然是一项耗时且昂贵的任务。大多数训练数据也必须由人来标记,以使得人工智能模型能够学习并变得熟练。越来越多担心的是偏差正在蔓延到训练数据中。

然后是黑盒问题:仍然很难确定的是,AI模型如何做出决策。这种不确定性对于自动驾驶系统来说仍然是一个大问题。需要更好的解决方案。

另一个问题涉及模型对微小数据变化的敏感性。该漏洞引发了安全问题,包括入侵自动驾驶系统的可能性,以及由此产生的对自动驾驶汽车安全的威胁。

缺乏人工智能专业知识是汽车和其他行业的另一大缺点,技能差距不太可能很快得到弥补。

解决问题的推理阶段也有缺点。大型模型,尤其是自动驾驶汽车模型,需要巨大的计算资源来处理传感器数据及支持复杂的软件。这些资源还需要电力,但这在汽车应用中总是有限的。

新兴技术将会提高性能并降低推理成本。它们包括新的人工智能芯片技术、低成本的激光雷达(LiDAR)和性能更高的传感器。

推理的最大缺点是黑盒问题或人工智能可解释性。人工智能系统仍然无法解释它们是如何做出决策的,从而产生了许多人工智能信任问题。对于汽车应用来说,这是行不通的。

与其他消费领域相比,汽车人工智能需要更高的安全性。因此,必须更加重视人工智能的安全与研发。因此,乔治城大学的安全和新兴技术中心(CSET)发布了一份开创性的报告,阐述了人工智能的意外后果和潜在影响。

CSET报告确定了三种基本类型的人工智能故障:鲁棒性故障、规范故障和保证故障。鲁棒性故障意味着人工智能系统接收到异常或意外的输入并因此发生故障。在规范故障中,人工智能系统试图实现与设计者意图略有不同的事情,从而导致意想不到的行为或副作用。保证故障意味着人工智能系统在运行过程中无法得到充分的监控或控制。

这份于2021年7月发布的报告,列举了人工智能意外崩溃的示例(作者更喜欢“事故”一词),并建议采取措施降低风险,同时让人工智能工具更值得信赖。

可解释人工智能(XAI)是一种减轻黑盒效应的方法,它可以更好地了解提高模型准确性所需的数据。由美国国防高级研究计划署(Darpa)赞助的可解释人工智能研究,旨在开发机器学习技术,以产生更多可解释的模型,同时保持高水平的学习性能和准确性。可解释人工智能还将使人类用户能够理解、信任和管理人工智能模型。可解释人工智能还可以描述其自身的能力并提供对其未来行为的见解。

人工智能和通用数据保护条例(GDPR)密切相关。GDPR影响着欧洲和其他地区的人工智能发展。该法规明确涵盖了自动化个人决策和分析。该规定保护消费者免受两者的法律后果。在这种情况下,自动化个人决策包括人工智能平台在没有任何人工干预的情况下所做出的决策。分析是指自动处理个人数据来评估个体。

对于汽车应用,这主要影响内容交付系统和用户界面。

欧盟正在准备一项类似于GDPR的人工智能法规,它可能会产生同样广泛的影响。代表监管人工智能的法律框架的提案草案已在2021年4月发布。

欧盟提案旨在确定高风险人工智能技术及其针对其可能危及公民的交通等关键基础设施的应用。这意味着自动驾驶汽车(AVs)将成为人工智能监管的目标。

根据欧盟倡导的人工智能立法,罚款可能高达3000万欧元,或占在全球收入的6%,以较高者为准。通用数据保护条例(GDPR)规定的最高罚款为2000万欧元,或全球收入的4%。

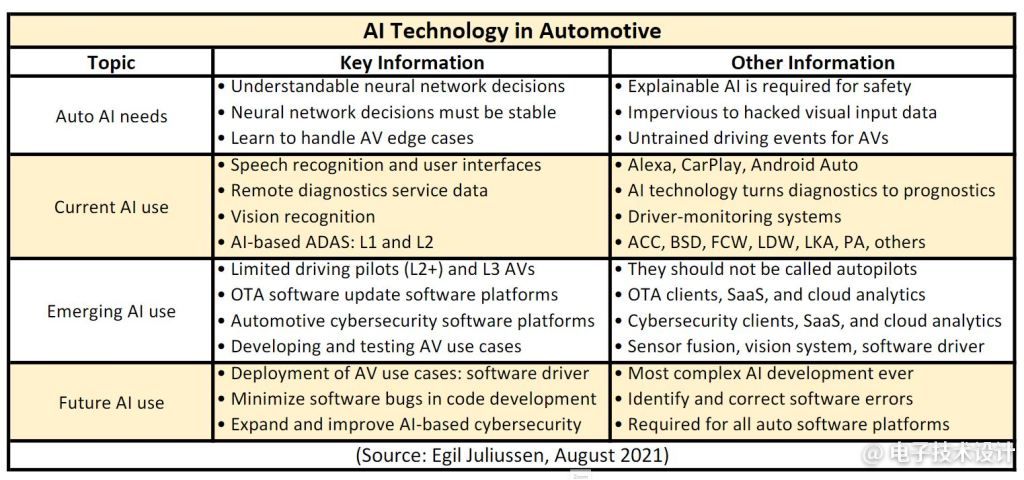

图2总结了人工智能技术在汽车电子上的集成。不包括在汽车制造、供应链管理、质量控制、市场,以及在人工智能领域做出重大贡献的类似功能中所用的人工智能。

图2:汽车人工智能技术。

神经网络所生成的决策必须是可以理解的。如果不是这样,就很难理解它们是如何工作的并纠正误差或偏差。

神经网络的决策也必须是稳定的——也就是说,尽管视觉数据存在微小差异,但仍保持不变。

这对于自动驾驶汽车尤其重要。对基于人工智能的视觉系统来说,可能看不到停车标志上的小条黑白胶带。这就是一个不可接受的神经网络性能的例子。

自动驾驶汽车应用需要使用更好的技术来了解以前软件驾驶员训练所没有经历过的边缘案例或新的驾驶事件。这仍然是大规模部署自动驾驶汽车系统的关键限制因素。

语音识别和用户界面一直是汽车领域中最成功的基于人工智能的应用。这些应用利用智能手机和消费电子产品中所使用的人工智能技术,将其部署在信息娱乐和人机交互界面中。Alexa、CarPlay、Android Auto等产品已在大多数新模型和模型更新中引入。

远程诊断是领先的远程信息处理技术应用。例如,添加人工智能技术,可以帮助预测装置故障。

配备了ADAS的汽车已将基于人工智能的视觉系统用于驾驶员监控系统(DMS)。随着人工智能技术的改进,DMS有望实现快速增长。

许多ADAS功能也使用人工智能技术,包括自适应巡航控制和多个版本的停车辅助。L1和L2 ADAS车辆将在新车型中使用越来越多的人工智能技术。

有限驾驶辅助系统(Limited driving pilot)正在从多个OEM厂商中兴起。它们通常被称为L2+,但该术语不包含在当前标准中。称它们为自动驾驶仪(autopilot)是错误的,因为这会让消费者感到疑惑,暗示其比现在有更多的能力。并且它们已经造成了事故。

L3车辆已经面世多年,但监管限制已对其部署做出了限制。允许L3自动驾驶汽车的法规正在出现,而L3车辆当中使用了大量的人工智能技术。

OTA软件和网络安全这两个功能都通过嵌入式软件客户端以及基于云端的服务和分析软件加入进人工智能技术。

一种新兴的人工智能应用是针对多个自动驾驶汽车用例的自动驾驶汽车开发和测试。估计有5,000辆自动驾驶汽车处于测试或试驾模式,主要在中国和美国,其中包括货物自动驾驶汽车、自动驾驶卡车、自动驾驶出租车和固定路线自动驾驶汽车。

自动驾驶汽车用例是最具价值和困难的人工智能技术应用。其目标是实现一个比最好的人类驾驶员更好的软件驾驶员,而没有人类行为的缺点。

面向人工智能技术改进的软件开发已经成熟。通过创新的人工智能技术来鉴别和修复软件的漏洞可能会在未来十年内发生。

源自人工智能技术的网络安全进步,可能是汽车行业和其他行业最迫切的需求。这些需求正在吸引大量可持续的投资。

人工智能技术已成为汽车行业的主要驱动力。到目前为止,已有两家公司率先在汽车领域采用人工智能技术:英伟达(NVIDIA)和特斯拉(Tesla)。在为创建和使用AI模型提供芯片和软件标准方面,英伟达是明显的领导者。特斯拉则正在稳健地部署人工智能,尤其是在其看好的自动驾驶仪上。

与此同时,更多的公司专注于汽车人工智能。Mobileye是ADAS推动的领导者,而自动驾驶汽车已处于其计划当中;Google-Waymo则率先开发了基于软件的驾驶员。

随着安全问题的增加,人工智能开发人员必须留意警告信号,以免意外后果扼杀创新。

排在首位的是打开限制信任系统部署的人工智能黑盒子。在其他地方,训练数据中的偏差是一个日益严重、难以评估也难以解决的问题。

欧盟正在制定人工智能法规,其他地区也将效仿。

在可预见的未来,人工智能开发人员必须谨慎地构建安全、强大的自动化系统。

(原文刊登于EDN姐妹网站EE Times欧洲版,参考链接:AI's Impact on the Current and Future Automotive Industry,由Franklin Zhao编译。)

本文为《电子技术设计》2022年2月刊杂志文章,版权所有,禁止转载。免费杂志订阅申请点击这里。

最前沿的电子设计资讯

最前沿的电子设计资讯